Ollama: vägen till hundratals AI-modeller

Medan ChatGPT har kring 700 miljoner användare i veckan är det väldigt få som installerat en AI lokalt. Det är synd eftersom det (1) är mycket enklare än man kan tro och (2) finns gott om skäl att köra en modell lokalt (särskilt för kommersiella ändamål):

- Full kontroll över data, inget lämnar din dator

- Noll kostnad per fråga, inga API-tokens eller credits

- Ingen nätverkslatens, svaren kommer direkt

- Möjlighet att experimentera med olika modeller och inställningar

- Full frihet i att bygga vidare och integrera i egna arbetsflöden

Dessutom ger den här typen av experiment en fylligare upplevelse av de olika modellernas egenheter och större insikt i hur de resonerar.

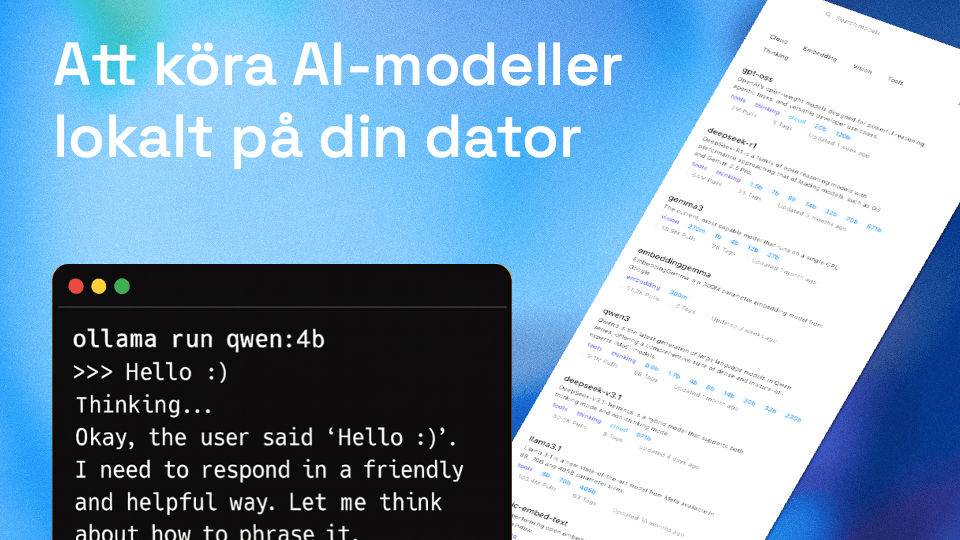

Personligen tycker jag Ollama är det bästa verktyget på området. Efter att ha laddat ner och installerat Ollama kan du starta modeller direkt från en terminal (om du är ovan vid det kan du kolla här för Mac, här för Windows, Linux; ni vet redan).

Som exempel har jag valt Qwen3:4B. Qwen är en av de mest intressanta open source-familjerna just nu, utvecklad av Alibaba, och 4B-varianten är både lättkörd och förvånansvärt kapabel. På begränsad hårdvara blir den möjligen väl självreflekterande med en tendens att överanalysera, något som ofta har stort underhållningsvärde (mer om det nedan).

ollama run qwen3:4bI Ollamas modellbibliotek finns ett stort utbud av alternativa modeller, allt från små modeller på några hundra MB till större varianter som kräver mer kraftfull hårdvara; exempelvis omtalade deepseek-r1. De flesta modellfamiljer har alternativa storlekar så du kan anpassa valet till din dators kapacitet.

Qwen 3:4B fungerar även på äldre datorer, som min laptop från 2017, och till och med på telefoner. Vill man nå högre kvalitet, jämförbar med modeller som bara ligger 6–9 månader efter den absoluta frontlinjen, krävs ett kraftfullt dedikerat grafikkort, till exempel ett RTX 5090 från Nvidia.

En av de saker jag gillar med att köra dessa modeller lokalt är att man får full insikt i deras tankekedjor (Chain-of-Thought eller CoT). I exemplet nedan kan du följa Qwen 3:s steg, funderingar och självkorrigeringar. Det här är en fräsch kontrast till tjänster som ChatGPT där man oftast bara får det färdiga svaret, utan att se hur modellen kom fram till det. Som jag nämnde tidigt blir resultatet på min gamla laptop ibland ganska komiskt. Här är ett exempel på hur övertänkande modellen kan bli:

(Emil)

>>> Hello :)

(Qwen3)

Thinking...

Okay, the user said "Hello!" So I need to respond appropriately. Let me think... First, I should greet them back in a friendly and helpful way. Maybe add a smiley emoji to

keep it warm.

I should make sure the response is simple and not too long. Let me check if there's any cultural context I need to consider, but since it's a general greeting, probably

standard English is fine.

Also, I should be ready to assist them further. Maybe add a phrase like "How can I help you today?" to encourage them to ask questions or get assistance.

Wait, the user might be testing if the AI responds correctly. Let me make sure the response is accurate. No markdown, just plain text. Let me draft it: "Hello! 😊 How can

I help you today?"

Yes, that sounds good. It's friendly, includes an emoji, and offers assistance. I think that's a solid response.

...done thinking.

>>> Hello! 😊 How can I help you today? Föredrar du en mer ChatGPT-liknande upplevelse kan du använda gränssnitt som Chatbox eller Open WebUI. Då får du en webbaserad miljö där du till och med kan bjuda in andra användare att interagera med modellen, ungefär som en helt privat ChatGPT.

Nästa steg är att börja sätta upp tillämpningar av din lokala modell. Friheten i hur du kan göra det är ett stort argument för att experimenter med lokala AI-modeller. Det ämnet får jag återkomma till i framtida inlägg. Har du egna erfarenheter som du vill att jag belyser däri så dela gärna nedan eller i DM till mig.

//Emil

If you are looking for another cog in the machinery...

There are plenty of other consulting firms that offer those. But if you value key people with stellar development skills that will make a difference for your development team and your business. Then, leave it in our care!

DROP US AN EMAIL